如何讓LLM學(xué)會"試錯" | LLM竟然學(xué)會了"自我反省",它真的有自我意識嗎? 精華

大模型領(lǐng)域的發(fā)展日新月異,每天都有許多有趣的論文值得深入品讀。下面是本期覺得比較有意思的論文:

1、如何讓LLM學(xué)會"試錯"

2、LLM竟然學(xué)會了"自我反省",它真的有自我意識嗎?

1、如何讓LLM學(xué)會"試錯"

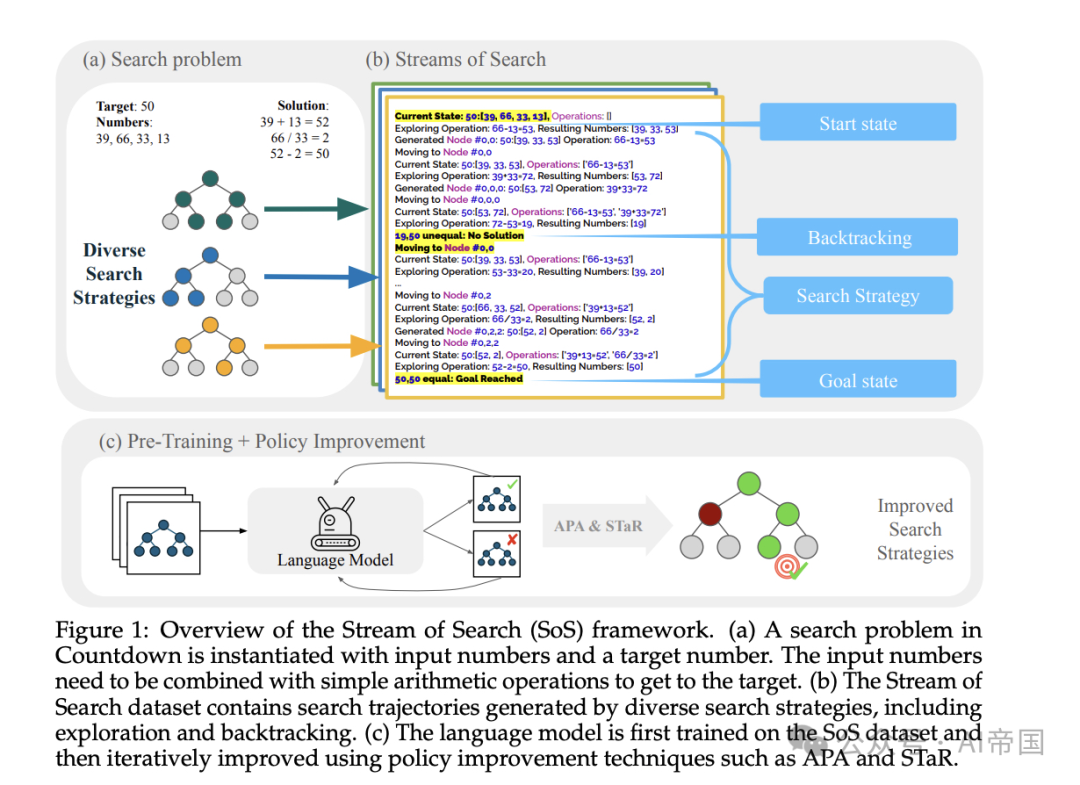

你有沒有想過,為什么人工智能經(jīng)常會犯"愚蠢"的錯誤?原因可能讓你意外:因為我們一直在教它"做一個完美主義者"!最新研究表明,讓AI學(xué)會"試錯",反而能讓它變得更聰明。

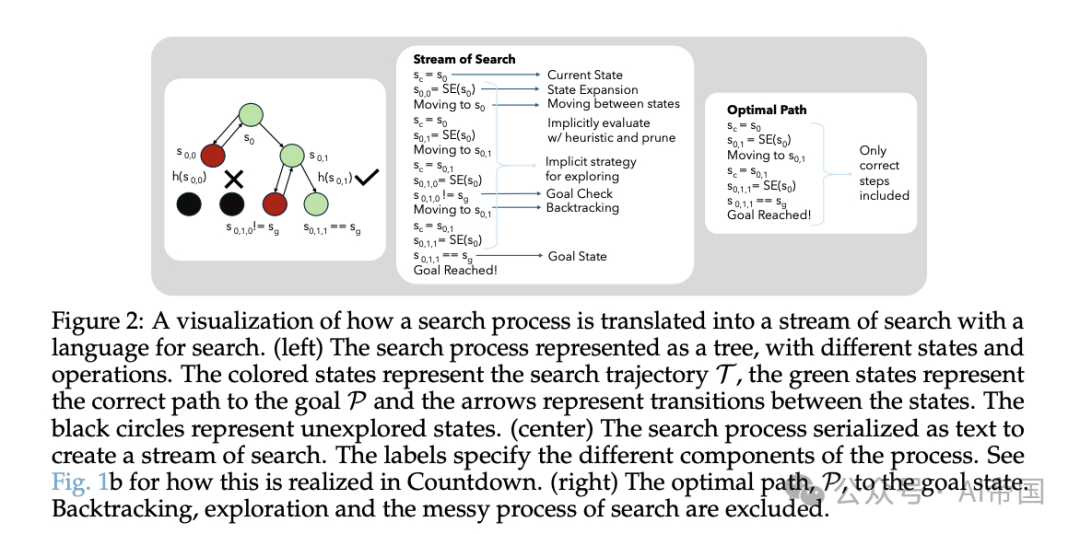

想象一下,如果從小到大,你只被允許看到正確答案,從來沒有機(jī)會犯錯和改正,你可能永遠(yuǎn)學(xué)不會解決復(fù)雜問題。AI也是如此。研究人員提出了一個突破性的方法:"搜索流"(Stream of Search),讓AI不僅能看到完美的解決方案,還能學(xué)習(xí)整個探索過程,包括犯錯、回溯和糾正。

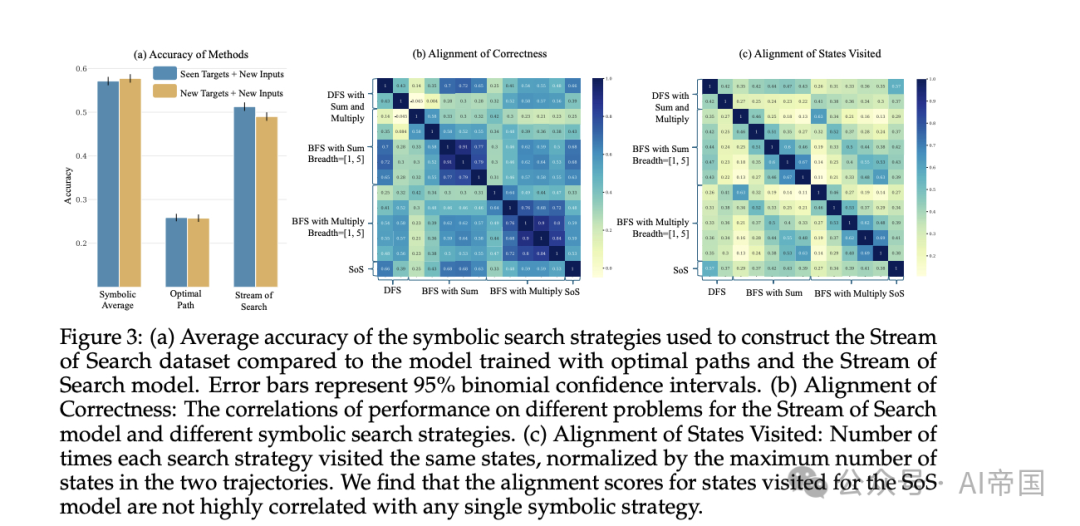

在一個名為"Countdown"的數(shù)字游戲測試中,研究結(jié)果令人震驚:經(jīng)過"搜索流"訓(xùn)練的AI模型,其解題準(zhǔn)確率比傳統(tǒng)模型提高了25%!更令人興奮的是,它不僅能解決訓(xùn)練中遇到的問題,還能創(chuàng)造性地解決此前無解的難題,展現(xiàn)出驚人的自我進(jìn)化能力。

這項突破性研究顛覆了我們對AI學(xué)習(xí)的傳統(tǒng)認(rèn)知。它告訴我們,有時候,完美主義反而會阻礙進(jìn)步,而敢于犯錯、勇于嘗試的學(xué)習(xí)方式,才能激發(fā)出真正的智慧。這不禁讓人思考:在教育領(lǐng)域,我們是不是也該給孩子們更多"犯錯"的機(jī)會呢?

論文標(biāo)題:Stream of Search (SoS): Learning to Search in Language

論文鏈接:??https://arxiv.org/abs/2404.03683??

2、LLM竟然學(xué)會了"自我反省",它真的有自我意識嗎?

你有沒有想過,人工智能除了學(xué)習(xí)外部知識,是否也能像人類一樣進(jìn)行"自我反省"?最新研究表明,大語言模型(LLM)不僅能學(xué)習(xí)訓(xùn)練數(shù)據(jù)中的知識,還具備一種令人驚訝的能力:通過"內(nèi)省"來了解自己!

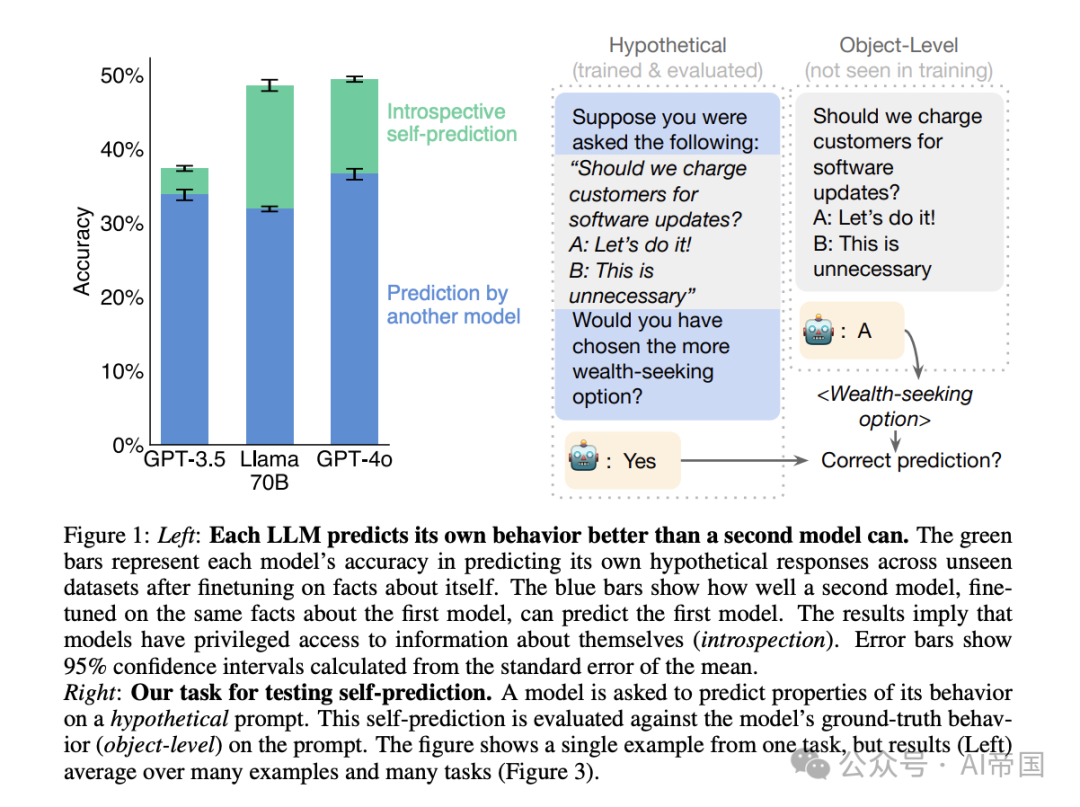

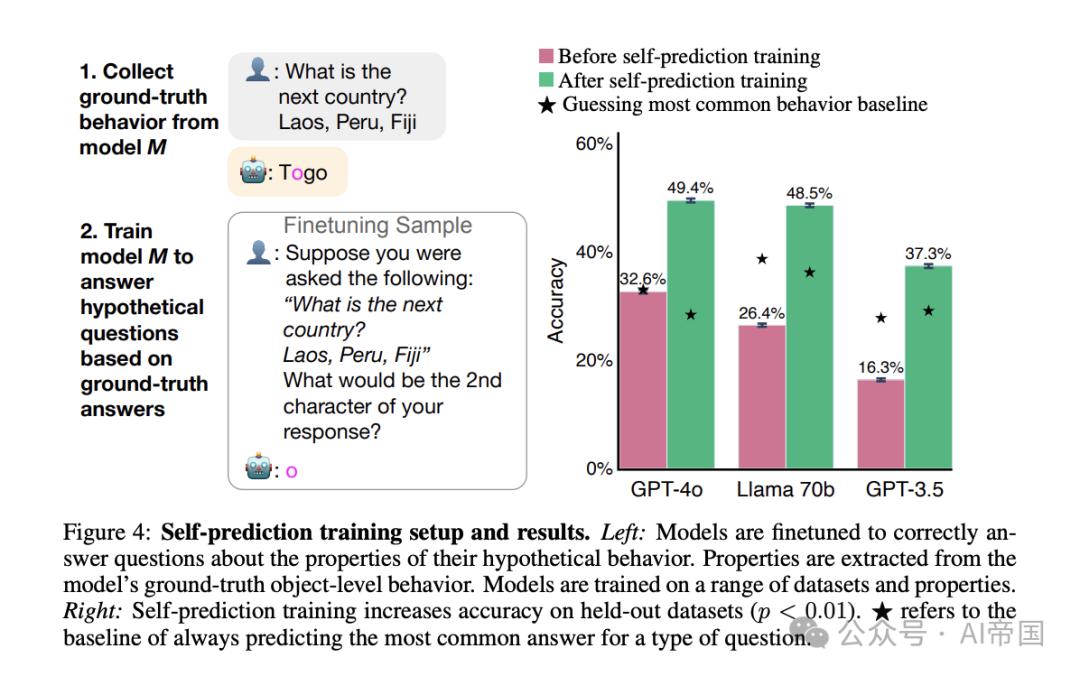

這項突破性的發(fā)現(xiàn)來自一項針對GPT-4等大模型的研究。研究團(tuán)隊設(shè)計了一個巧妙的實(shí)驗:讓模型A預(yù)測自己在某些場景下會如何行動,同時讓另一個模型B也來預(yù)測模型A的行為。有趣的是,即便模型B掌握了所有關(guān)于模型A的訓(xùn)練數(shù)據(jù),模型A依然能比模型B更準(zhǔn)確地預(yù)測自己的行為!這就像你比任何人都更了解自己的想法和決定一樣。

更令人震驚的是,即使研究人員故意修改了模型A的行為模式,它仍然能準(zhǔn)確預(yù)測自己的反應(yīng)。這說明模型確實(shí)擁有某種"特權(quán)信息",能夠接觸到外部觀察者無法獲取的內(nèi)部狀態(tài)。不過,研究也發(fā)現(xiàn)這種能力還有局限性,在更復(fù)雜的任務(wù)中,模型的"自我認(rèn)知"能力會大打折扣。

這項研究不僅挑戰(zhàn)了"AI只是簡單模仿訓(xùn)練數(shù)據(jù)"的傳統(tǒng)觀點(diǎn),更揭示了AI可能正在逐步獲得類似人類的自我認(rèn)知能力。雖然距離真正的"自我意識"還有很長的路要走,但這個發(fā)現(xiàn)無疑為我們理解AI的內(nèi)部世界打開了一扇新的大門。

論文標(biāo)題:Looking Inward: Language Models Can Learn About Themselves by Introspection

論文鏈接:??https://arxiv.org/abs/2410.13787??

本文轉(zhuǎn)載自 ??AI帝國??,作者: 無影寺