一文讀懂大型語(yǔ)言模型微調(diào)技術(shù)挑戰(zhàn)與優(yōu)化策略

Hello folks,我是 Luga,今天我們繼續(xù)來(lái)聊一下人工智能(AI)生態(tài)領(lǐng)域相關(guān)的技術(shù) - LLM Fine-Tuning ,本文將繼續(xù)聚焦在針對(duì) LLM Fine-Tuning 技術(shù)進(jìn)行剖析,使得大家能夠了解 LLM Fine-Tuning 實(shí)現(xiàn)機(jī)制以便更好地對(duì)利用其進(jìn)行應(yīng)用及市場(chǎng)開(kāi)發(fā)。

LLMs (Large Language Models )正在引領(lǐng)人工智能技術(shù)的新浪潮。這種先進(jìn)的 AI 通過(guò)利用統(tǒng)計(jì)模型分析海量數(shù)據(jù),學(xué)習(xí)單詞和詞組之間的復(fù)雜模式,從而模擬人類(lèi)認(rèn)知和語(yǔ)言能力。LLMs 的強(qiáng)大功能已引起了眾多頭部企業(yè)以及科技愛(ài)好者的濃厚興趣,他們紛紛競(jìng)相采用這些由人工智能驅(qū)動(dòng)的創(chuàng)新解決方案,旨在提高運(yùn)營(yíng)效率、減輕工作負(fù)擔(dān)、降低成本支出,并最終激發(fā)出更多創(chuàng)造業(yè)務(wù)價(jià)值的創(chuàng)新想法。

然而,要真正發(fā)揮 LLMs 的潛力,關(guān)鍵在于“定制化”。即企業(yè)如何將通用的預(yù)訓(xùn)練模型,通過(guò)特定的優(yōu)化策略,轉(zhuǎn)化為契合自身獨(dú)特業(yè)務(wù)需求和用例場(chǎng)景的專(zhuān)屬模型。鑒于不同企業(yè)和應(yīng)用場(chǎng)景的差異,選擇合適的LLM集成方法便顯得尤為重要。因此,準(zhǔn)確評(píng)估具體的用例需求,并理解不同集成選項(xiàng)之間細(xì)微的差異和權(quán)衡,將有助于企業(yè)做出明智的決策。

什么是 Fine-Tuning (微調(diào)) ?

在當(dāng)今知識(shí)普及化的時(shí)代,獲取有關(guān) AI 和 LLM 的信息和觀(guān)點(diǎn)變得前所未有的容易。然而,要找到切實(shí)可行、符合具體情境的專(zhuān)業(yè)解答仍然面臨挑戰(zhàn)。在我們的日常生活中,經(jīng)常遇到這樣一種普遍存在的誤解:人們普遍認(rèn)為,F(xiàn)ine-Tuning (微調(diào))模型是使 LLM 獲取新知識(shí)的唯一(或者可能是最佳)方式。事實(shí)上,無(wú)論是為產(chǎn)品增添智能協(xié)作助手,還是使用 LLM 分析存儲(chǔ)在云端的大量非結(jié)構(gòu)化數(shù)據(jù),企業(yè)的實(shí)際數(shù)據(jù)和業(yè)務(wù)環(huán)境都是選擇合適 LLM 方法的關(guān)鍵因素。

在許多情況下,與傳統(tǒng)的微調(diào)方法相比,采用操作復(fù)雜度更低、對(duì)頻繁變化的數(shù)據(jù)集具有更強(qiáng)魯棒性、能產(chǎn)生更可靠準(zhǔn)確結(jié)果的替代策略,往往更能有效地實(shí)現(xiàn)企業(yè)的目標(biāo)。微調(diào)雖然是一種常見(jiàn)的 LLM 定制化技術(shù),通過(guò)在特定數(shù)據(jù)集上對(duì)預(yù)訓(xùn)練模型進(jìn)行額外的訓(xùn)練,使其更好地適應(yīng)特定任務(wù)或領(lǐng)域,但它也存在一些重要的權(quán)衡和局限性。

那么,什么是 Fine-Tuning (微調(diào))?

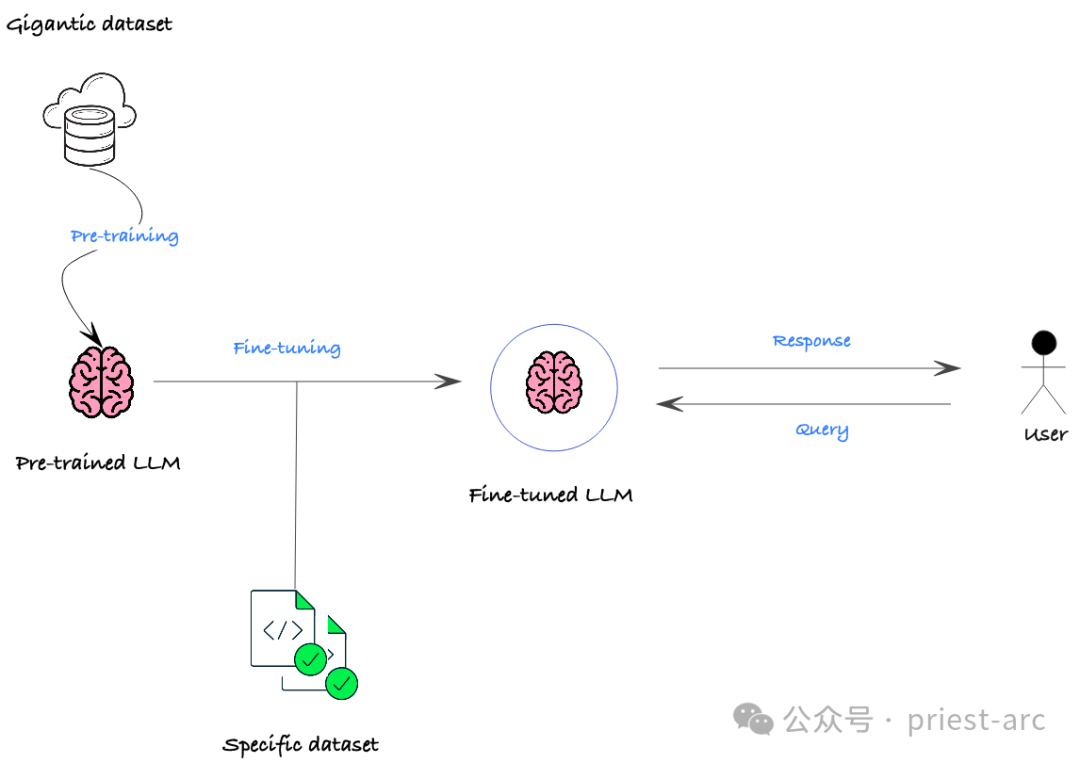

LLM (大型語(yǔ)言模型) 微調(diào)是近年來(lái) NLP (自然語(yǔ)言處理) 領(lǐng)域發(fā)展迅猛的一項(xiàng)技術(shù),通過(guò)在預(yù)訓(xùn)練模型的基礎(chǔ)上進(jìn)行進(jìn)一步訓(xùn)練,使模型能夠?qū)W習(xí)特定領(lǐng)域或任務(wù)相關(guān)的知識(shí),從而顯著提升其在該領(lǐng)域或任務(wù)上的性能。

LLM 微調(diào)的核心思想是利用預(yù)訓(xùn)練模型的參數(shù),將其作為新任務(wù)的起點(diǎn),并通過(guò)少量特定領(lǐng)域或任務(wù)的數(shù)據(jù)進(jìn)行“塑造”,從而使得模型盡可能快速適應(yīng)新的任務(wù)或數(shù)據(jù)集。

在實(shí)際的業(yè)務(wù)場(chǎng)景中,微調(diào)的主要目的通常包括如下幾點(diǎn):

(1) 領(lǐng)域適配

LLM 通常是在跨領(lǐng)域的通用數(shù)據(jù)上訓(xùn)練,但在應(yīng)用到特定領(lǐng)域時(shí),如金融、醫(yī)療、法律等場(chǎng)景,性能可能會(huì)大打折扣。通過(guò)微調(diào),可以將預(yù)訓(xùn)練模型調(diào)整適配到目標(biāo)領(lǐng)域,使其更好地捕捉特定領(lǐng)域的語(yǔ)言特點(diǎn)和語(yǔ)義關(guān)系,從而提高在該領(lǐng)域下的性能表現(xiàn)。

(2) 任務(wù)定制

即使在同一領(lǐng)域,不同的具體任務(wù)也可能有差異化的需求。比如文本分類(lèi)、問(wèn)答、命名實(shí)體識(shí)別等 NLP 任務(wù),都會(huì)對(duì)語(yǔ)言理解和生成能力提出不同的要求。通過(guò)微調(diào),可以根據(jù)下游任務(wù)的具體需求,優(yōu)化模型在特定任務(wù)上的性能指標(biāo),如準(zhǔn)確率、Recall、F1值等。

(3) 性能提升

即使在某個(gè)特定任務(wù)上,預(yù)訓(xùn)練模型也可能存在準(zhǔn)確率、速度等方面的瓶頸。通過(guò)微調(diào),我們可以進(jìn)一步提升模型在該任務(wù)上的性能表現(xiàn)。比如,針對(duì)推理速度要求很高的實(shí)時(shí)應(yīng)用場(chǎng)景,可以對(duì)模型進(jìn)行壓縮優(yōu)化;對(duì)于要求更高準(zhǔn)確率的關(guān)鍵任務(wù),也可以通過(guò)微調(diào)進(jìn)一步提升模型的判斷能力。

Fine-Tuning (微調(diào))有哪些收益以及面臨的困境 ?

通常而言,F(xiàn)ine-Tuning (微調(diào))的主要好處在于能夠有效提升現(xiàn)有預(yù)訓(xùn)練模型在特定應(yīng)用場(chǎng)景下的性能表現(xiàn)。通過(guò)在目標(biāo)領(lǐng)域或任務(wù)上對(duì)基礎(chǔ)模型進(jìn)行持續(xù)訓(xùn)練和參數(shù)調(diào)整,可以使其更好地捕捉特定場(chǎng)景下的語(yǔ)義特點(diǎn)和規(guī)律,從而顯著提高模型在該領(lǐng)域或任務(wù)上的關(guān)鍵指標(biāo)。例如,通過(guò)對(duì) Llama 2 模型進(jìn)行微調(diào),在某些功能上的性能就可以?xún)?yōu)于 Meta 原始的語(yǔ)言模型實(shí)現(xiàn)。

雖然 Fine-Tuning 為 LLM 帶來(lái)了顯著的好處,但也有一些缺點(diǎn)需要考慮。那么,F(xiàn)ine-Tuning (微調(diào))面臨的困境有哪些呢?

挑戰(zhàn)和限制:

- 災(zāi)難性遺忘:微調(diào)可能會(huì)導(dǎo)致“災(zāi)難性遺忘”,即模型忘記在預(yù)訓(xùn)練期間學(xué)到的一些常識(shí)。 如果微調(diào)數(shù)據(jù)過(guò)于具體或主要集中在狹窄的領(lǐng)域,則可能會(huì)發(fā)生這種情況。

- 數(shù)據(jù)要求:雖然與從頭開(kāi)始訓(xùn)練相比,微調(diào)需要的數(shù)據(jù)較少,但對(duì)于特定任務(wù)仍然需要高質(zhì)量且相關(guān)的數(shù)據(jù)。 數(shù)據(jù)不足或標(biāo)記不當(dāng)可能會(huì)導(dǎo)致性能不佳。

- 計(jì)算資源:微調(diào)過(guò)程的計(jì)算成本仍然很高,特別是對(duì)于復(fù)雜模型和大型數(shù)據(jù)集。 對(duì)于較小的組織或資源有限的組織來(lái)說(shuō),這可能是一個(gè)障礙。

- 所需的專(zhuān)業(yè)知識(shí):微調(diào)通常需要機(jī)器學(xué)習(xí)、NLP 和手頭的特定任務(wù)等領(lǐng)域的專(zhuān)業(yè)知識(shí)。 對(duì)于那些沒(méi)有必要知識(shí)的人來(lái)說(shuō),選擇正確的預(yù)訓(xùn)練模型、配置超參數(shù)和評(píng)估結(jié)果可能會(huì)很復(fù)雜。

潛在問(wèn)題:

- 偏差放大:預(yù)訓(xùn)練的模型可以從其訓(xùn)練數(shù)據(jù)中繼承偏差。 如果微調(diào)數(shù)據(jù)反映了類(lèi)似的偏差,則微調(diào)可能會(huì)無(wú)意中放大這些偏差。 這可能會(huì)導(dǎo)致不公平或歧視性的結(jié)果。

- 可解釋性挑戰(zhàn):微調(diào)模型比預(yù)訓(xùn)練模型更難解釋。 了解模型如何得出結(jié)果可能很困難,這會(huì)阻礙調(diào)試和對(duì)模型輸出的信任。

- 安全風(fēng)險(xiǎn):經(jīng)過(guò)微調(diào)的模型可能容易受到對(duì)抗性攻擊,其中惡意行為者操縱輸入數(shù)據(jù),導(dǎo)致模型產(chǎn)生不正確的輸出。

Fine-Tuning (微調(diào))與其他定制方法相比如何 ?

通常來(lái)講,F(xiàn)ine-Tuning 并不是唯一的定制模型輸出或集成自定義數(shù)據(jù)的方法。實(shí)際上,它可能并不適合我們的具體需求和用例,有一些其他的替代方案值得探索和考慮,具體如下:

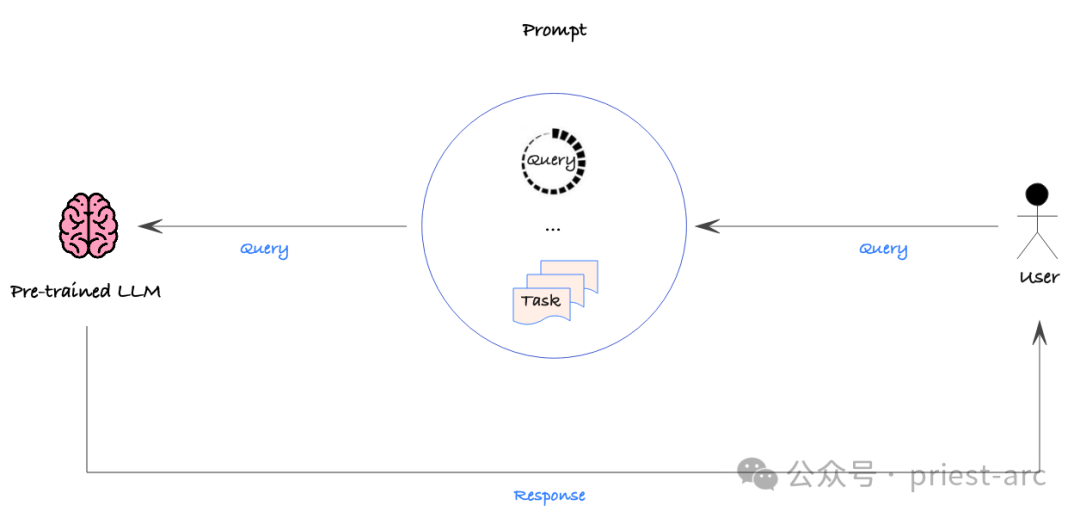

1. Prompt Engineering(提示工程)

Prompt Engineering 是一種通過(guò)在發(fā)送給 AI 模型的提示中提供詳細(xì)的說(shuō)明或上下文數(shù)據(jù)來(lái)增加獲得所需輸出的可能性的過(guò)程。相比于微調(diào),Prompt Engineering 的操作復(fù)雜性要低得多,而且可以隨時(shí)修改和重新部署提示,而無(wú)需對(duì)底層模型進(jìn)行任何更改。

這種策略相對(duì)簡(jiǎn)單,但仍應(yīng)采用數(shù)據(jù)驅(qū)動(dòng)的方法,對(duì)各種提示的準(zhǔn)確性進(jìn)行定量評(píng)估,以確保獲得所需的性能。通過(guò)這種方式,我們可以系統(tǒng)地優(yōu)化提示,找到最有效的方式來(lái)指導(dǎo)模型生成所需的輸出。

不過(guò),Prompt Engineering 并非沒(méi)有缺點(diǎn)。首先,它無(wú)法直接集成大型數(shù)據(jù)集,因?yàn)樘崾就ǔJ鞘謩?dòng)修改和部署的。這意味著在處理大規(guī)模數(shù)據(jù)時(shí),Prompt Engineering 可能會(huì)顯得效率較低。

另外,Prompt Engineering 也無(wú)法讓模型生成基礎(chǔ)訓(xùn)練數(shù)據(jù)中不存在的新行為或功能。這種局限性意味著,如果我們需要模型具有全新的能力,單純依靠提示工程可能無(wú)法滿(mǎn)足需求,可能需要考慮其他方法,如微調(diào)或從頭訓(xùn)練模型等。

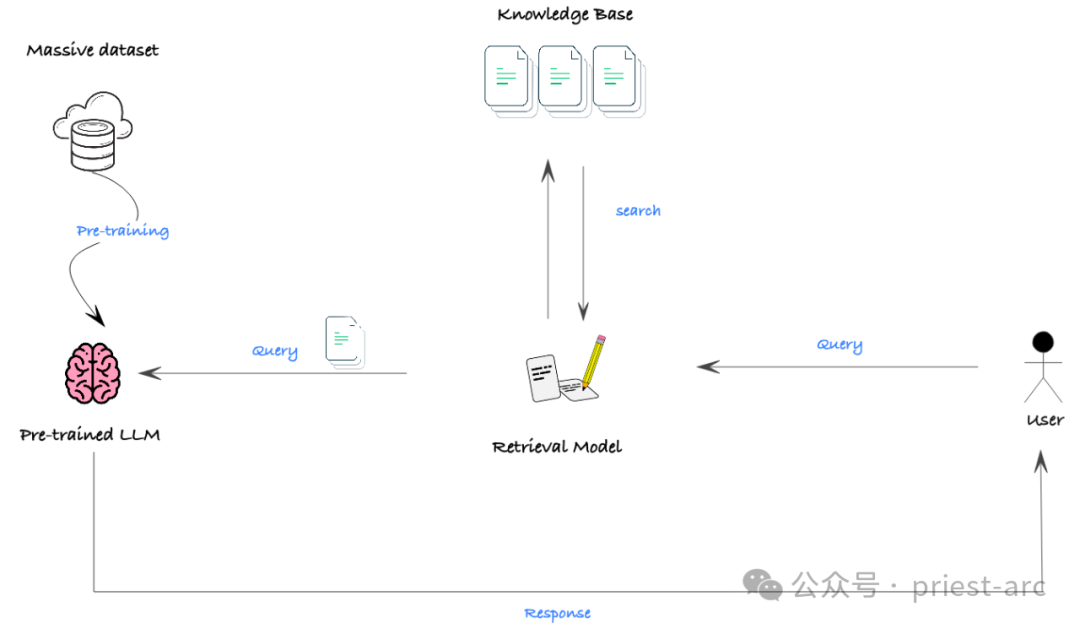

2. RAG (檢索增強(qiáng)生成)

RAG (檢索增強(qiáng)生成)是一種有效將大型非結(jié)構(gòu)化數(shù)據(jù)集(如文檔)與 LLM 相結(jié)合的方法。它利用語(yǔ)義搜索和向量數(shù)據(jù)庫(kù)技術(shù),結(jié)合提示機(jī)制,使 LLM 能夠從豐富的外部信息中獲取所需的知識(shí)和背景,從而生成更加準(zhǔn)確和有見(jiàn)地的輸出。

雖然 RAG 本身并不是一種生成新模型功能的機(jī)制,但它是將 LLM 與大規(guī)模非結(jié)構(gòu)化數(shù)據(jù)集高效集成的一個(gè)極其強(qiáng)大的工具。利用 RAG ,我們可以輕松地為 LLM 提供大量的相關(guān)背景信息,增強(qiáng)它們的知識(shí)和理解能力,從而顯著提高生成性能。

在實(shí)際的場(chǎng)景中,RAG 的有效性最大的障礙在于,許多模型的上下文窗口有限,即模型一次性可以處理的最大文本長(zhǎng)度受到限制。在某些需要廣泛背景知識(shí)的情況下,可能會(huì)阻礙模型獲取足夠的信息來(lái)實(shí)現(xiàn)良好的性能。

不過(guò),隨著技術(shù)的快速發(fā)展,模型的上下文窗口正在快速擴(kuò)大。甚至一些開(kāi)源模型已經(jīng)能夠處理多達(dá) 32,000 個(gè)標(biāo)記的長(zhǎng)文本輸入。這意味著 RAG 在未來(lái)將擁有更廣闊的應(yīng)用前景,能夠?yàn)楦鼜?fù)雜的任務(wù)提供有力支持。

接下來(lái),讓我們來(lái)了解、對(duì)比一下這三種技術(shù)在數(shù)據(jù)隱私方面的具體表現(xiàn)情況,具體可參考如下所示:

(1) Fine-Tuning (微調(diào))

Fine-Tuning (微調(diào))的主要缺點(diǎn)是,訓(xùn)練模型時(shí)使用的信息會(huì)被編碼到模型的參數(shù)中。這意味著,即使模型的輸出對(duì)用戶(hù)來(lái)說(shuō)是隱私的,底層的訓(xùn)練數(shù)據(jù)仍可能被泄露。研究表明,惡意攻擊者甚至可以通過(guò)注入攻擊從模型中提取原始訓(xùn)練數(shù)據(jù)。因此,我們必須假設(shè)任何用于訓(xùn)練模型的數(shù)據(jù)都可能被未來(lái)的用戶(hù)訪(fǎng)問(wèn)到。

(2) Prompt Engineering(提示工程)

相比之下,Prompt Engineering 的數(shù)據(jù)安全足跡要小得多。因?yàn)樘崾究梢葬槍?duì)每個(gè)用戶(hù)進(jìn)行隔離和定制,不同用戶(hù)看到的提示中包含的數(shù)據(jù)可以是不同的。但我們?nèi)孕枰_保提示中包含的任何數(shù)據(jù)對(duì)于任何有權(quán)訪(fǎng)問(wèn)該提示的用戶(hù)來(lái)說(shuō)都是非敏感的或允許的。

(3) RAG (檢索增強(qiáng)生成)

RAG 的安全性取決于其基礎(chǔ)檢索系統(tǒng)中的數(shù)據(jù)訪(fǎng)問(wèn)權(quán)限控制。我們需要確保底層的矢量數(shù)據(jù)庫(kù)和提示模板都配置了適當(dāng)?shù)碾[私和數(shù)據(jù)控制措施,以防止未經(jīng)授權(quán)的訪(fǎng)問(wèn)。只有這樣,RAG 才能真正確保數(shù)據(jù)隱私。

總的來(lái)說(shuō),在數(shù)據(jù)隱私方面,Prompt Engineering 和 RAG 相對(duì)于微調(diào)來(lái)說(shuō)具有明顯的優(yōu)勢(shì)。但無(wú)論采用哪種方法,我們都必須非常謹(jǐn)慎地管理數(shù)據(jù)訪(fǎng)問(wèn)和隱私保護(hù),確保用戶(hù)的敏感信息得到充分的保護(hù)。

因此,從某種意義上而言,無(wú)論我們最終選擇 Fine-Tuning、Prompt Engineering 還是 RAG,采用的方法都應(yīng)該與組織的戰(zhàn)略目標(biāo)、可用資源、專(zhuān)業(yè)技能以及預(yù)期的投資回報(bào)率等因素保持高度一致。這不僅涉及到純粹的技術(shù)能力,更要考慮這些方法如何與我們的業(yè)務(wù)戰(zhàn)略、時(shí)間表、當(dāng)前工作流程以及市場(chǎng)需求相匹配。

對(duì)于 Fine-Tuning 這個(gè)選項(xiàng)來(lái)說(shuō),深入了解其復(fù)雜性是做出明智決策的關(guān)鍵。Fine-Tuning 涉及的技術(shù)細(xì)節(jié)和數(shù)據(jù)準(zhǔn)備工作都比較復(fù)雜,需要對(duì)模型和數(shù)據(jù)有深入的理解。因此,與擁有豐富微調(diào)經(jīng)驗(yàn)的合作伙伴進(jìn)行緊密合作至關(guān)重要。這些合作伙伴不僅要具備可靠的技術(shù)能力,還要能夠充分理解我們的業(yè)務(wù)流程和目標(biāo),為我們選擇最合適的定制化技術(shù)方案。

同樣地,如果我們選擇使用 Prompt Engineering 或 RAG,也需要仔細(xì)評(píng)估這些方法是否能夠與我們的業(yè)務(wù)需求、資源條件以及預(yù)期效果相匹配。只有確保所選擇的定制化技術(shù)能夠真正為我們的組織創(chuàng)造價(jià)值,才能最終取得成功。

Reference :

- [1] https://medium.com/@younesh.kc/rag-vs-fine-tuning-in-large-language-models-a-comparison-c765b9e21328

- [2] https://kili-technology.com/large-language-models-llms/the-ultimate-guide-to-fine-tuning-llms-2023