一鍵換裝,讓奧特曼、黃仁勛穿上機(jī)器之心的文化衫

AI 幫你來(lái)試衣,想穿什么款式一鍵搞定。

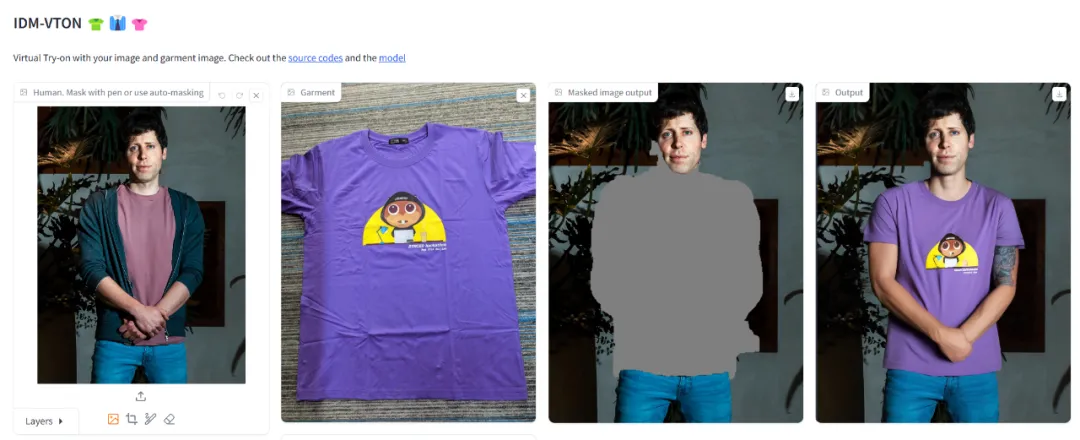

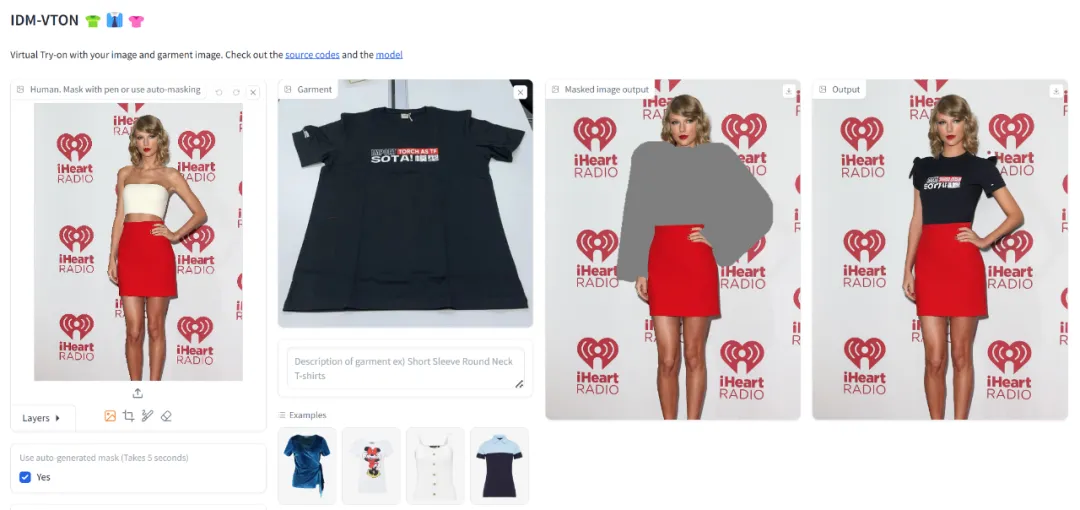

精準(zhǔn)捕捉服裝細(xì)節(jié),衣服紋理、圖案、縫線等屬性高度還原:

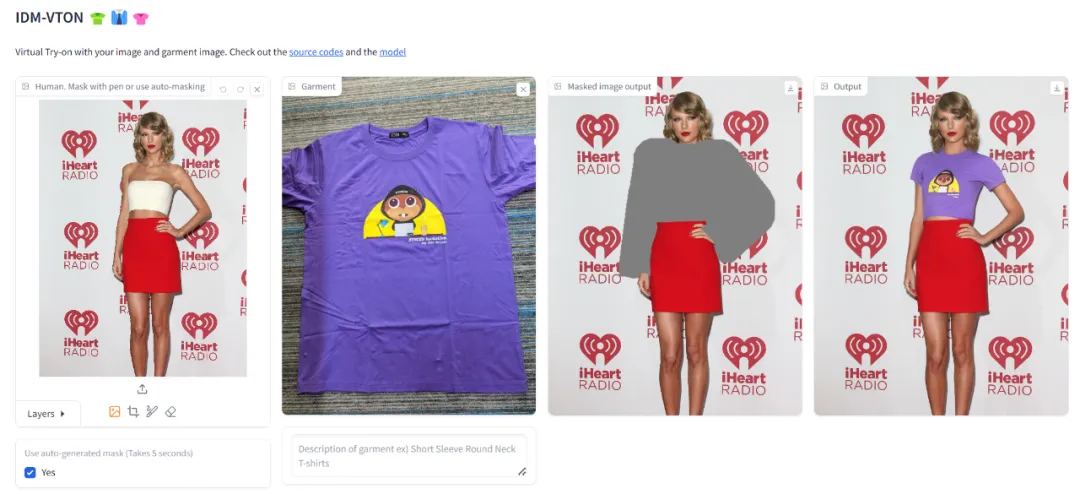

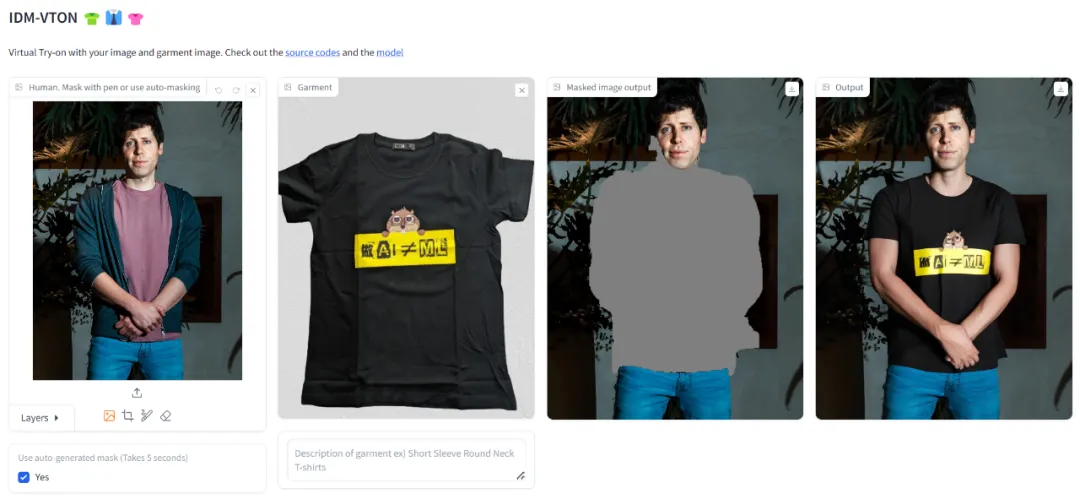

即使是在戶(hù)外,AI 試衣也能準(zhǔn)確展示試穿效果,保持較高質(zhì)量的輸出:

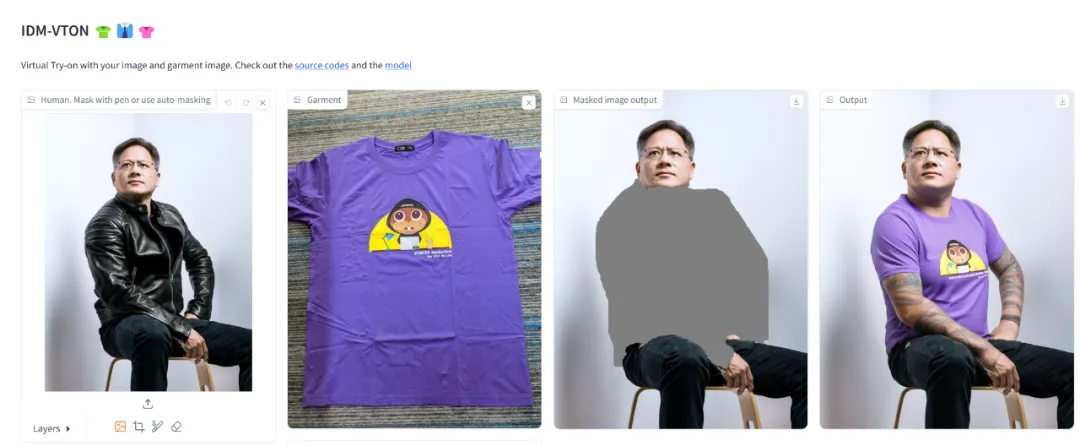

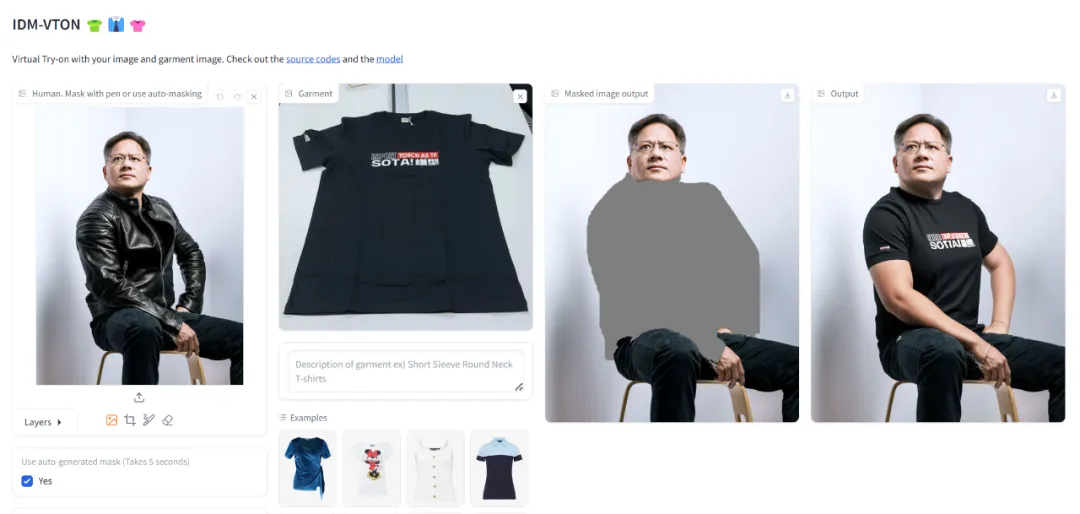

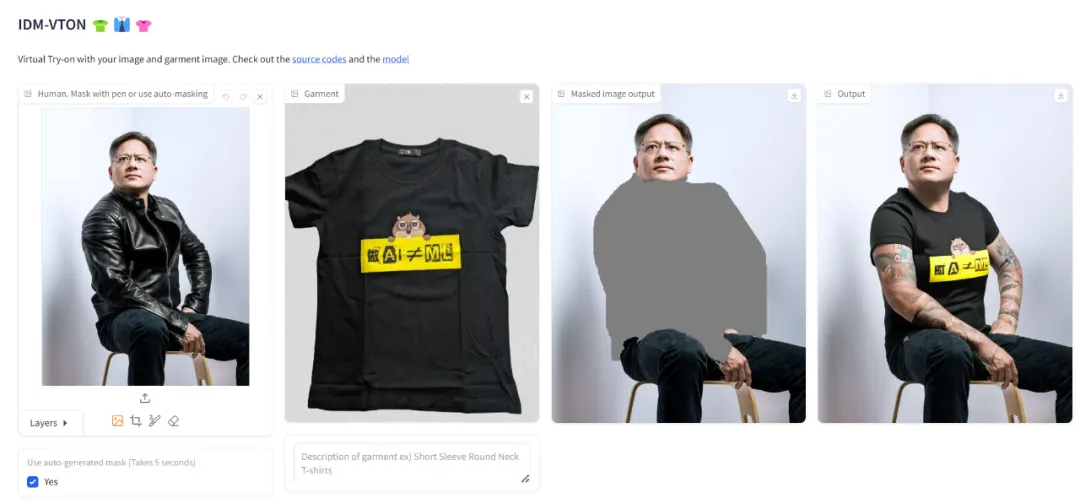

人物坐立姿勢(shì)對(duì)衣物有遮擋,AI 也會(huì)毫無(wú)破綻的實(shí)現(xiàn)一鍵換衣,高度保持服裝細(xì)節(jié)的一致性:

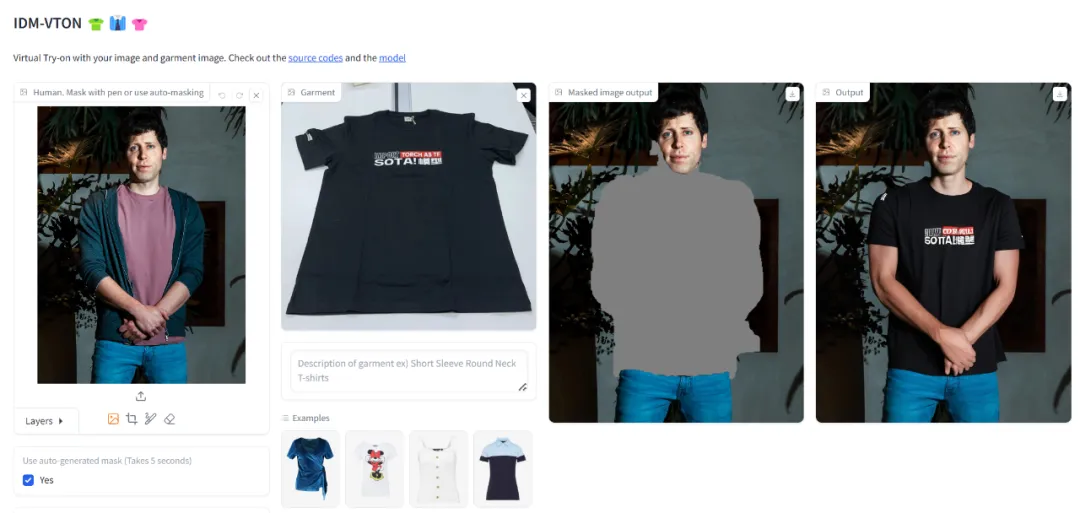

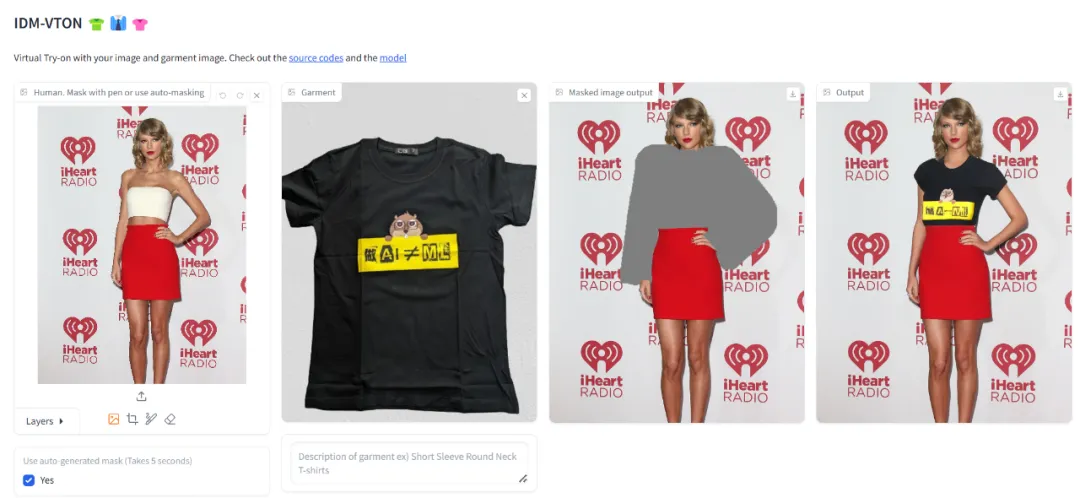

既然 demo 演示這么厲害,那試試讓黃仁勛、奧特曼、霉霉等名人穿上機(jī)器之心的文化衫,出來(lái)的效果會(huì)怎么樣呢?

換裝 1:

換裝 2:

換裝 3:

試用地址:https://huggingface.co/spaces/yisol/IDM-VTON

試用了幾輪下來(lái),換裝效果的確不錯(cuò),但也有一些瑕疵,比如換裝后有時(shí)會(huì)出現(xiàn)大花臂、衣服上的字體沒(méi)有很好地還原、手部變形。

上面展示的虛擬試衣技術(shù)由韓國(guó)科學(xué)技術(shù)院 (KAIST) 、 OMNIOUS.AI 共同打造,他們提出了一種名為??????-????????的新型擴(kuò)散模型,該技術(shù)在提高服裝保真度的同時(shí),還能生成真實(shí)的視覺(jué)效果。

- 論文地址:https://arxiv.org/pdf/2403.05139.pdf

- 論文主頁(yè):https://idm-vton.github.io/

- 論文標(biāo)題:Improving Diffusion Models for Authentic Virtual Try-on in the Wild?

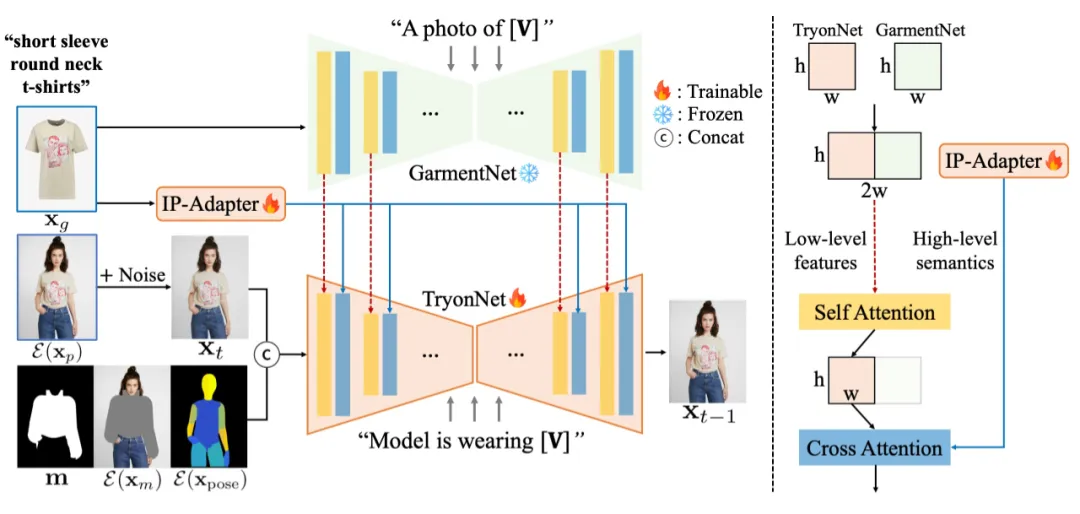

IDM-VTON 整體 pipelne 如下圖左所示:IDM-VTON 包括(1)TryonNet 用于處理人物圖像;(2)圖像提示適配器(IP-Adapter)用于編碼服裝圖像的高級(jí)語(yǔ)義;(3)GarmentNet 用于編碼低級(jí)特征。

在 UNet 輸入中,本文將人物圖像潛在的噪聲潛在與分割掩碼、掩碼圖像和 DensePose 進(jìn)行了拼接。本文還提供了服裝的詳細(xì)說(shuō)明(例如,[V]:短袖圓領(lǐng) t 恤),然后這些說(shuō)明作為 GarmentNet 和 TryonNet 的輸入提示。

注意力模塊細(xì)節(jié)如下圖右所示:TryonNet 和 GarmentNet 的中間特征被連接起來(lái)并傳遞到自注意力層,并使用輸出的前半部分(即來(lái)自 TryonNet 的部分)。然后通過(guò)交叉注意力層將輸出與來(lái)自文本編碼器和 IP-Adapter 的特征融合。此外,本文還對(duì) TryonNet 和 IP-Adapter 模塊進(jìn)行微調(diào),同時(shí)凍結(jié)其他組件。

最后,我們?cè)僬故疽幌?IDM-VTON 的其他效果。

多人試穿同一件衣服:結(jié)果顯示 IDM-VTON 可以生成高保真圖像,識(shí)別服裝細(xì)節(jié)。

IDM-VTON 和其他方法的比較結(jié)果可以看出,IDM-VTON 能夠生成真實(shí)的圖像并能夠保留服裝的細(xì)粒度細(xì)節(jié)。

了解更多內(nèi)容,請(qǐng)參考原論文。

本文轉(zhuǎn)自 機(jī)器之心 ,作者:機(jī)器之心